Что такое A/B-тестирование и как его проводить

*Обновление статьи

Бизнес не стоит на месте – чтобы выжить, нужно развиваться. Если остановить этот процесс, проект начнет деградировать. Часто приходится что-то менять – расширять ассортимент, увеличивать рекламный охват аудитории, улучшать дизайн сайта, добавлять новый, повышать конверсию. Как узнать заранее, что принесут эти новшества?

Одни из инструментов, помогающий развитию веб-проектов – A/B-тестирование. С его помощью можно проверить свои гипотезы и экспериментально оценить предпочтения посетителей – чтобы принять решение о том, стоит ли что-то менять или лучше оставить как есть.

Рассказываем, как это работает.

Что такое A/B-тестирование

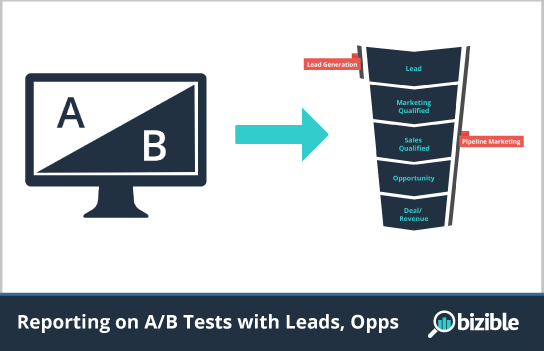

A/B-тестирование — это маркетинговый метод, использующийся для оценки и управления эффективностью веб-страницы. Этот метод также называется сплит-тестированием (от англ. split testing — раздельное тестирование).

A/B-тестирование позволяет оценивать количественные показатели работы двух вариантов веб-страницы, а также сравнивать их между собой.

Сплит-тестирование начинается с оценки метрик существующей веб-страницы (A, контрольная страница) и поиска способов ее улучшения. Например, вы создали интернет-магазин. Представьте себе посадочную страницу этого магазина с коэффициентом конверсии 2%. Маркетолог желает увеличить этот показатель до 4%, поэтому планирует изменения, которые помогут решить эту задачу.

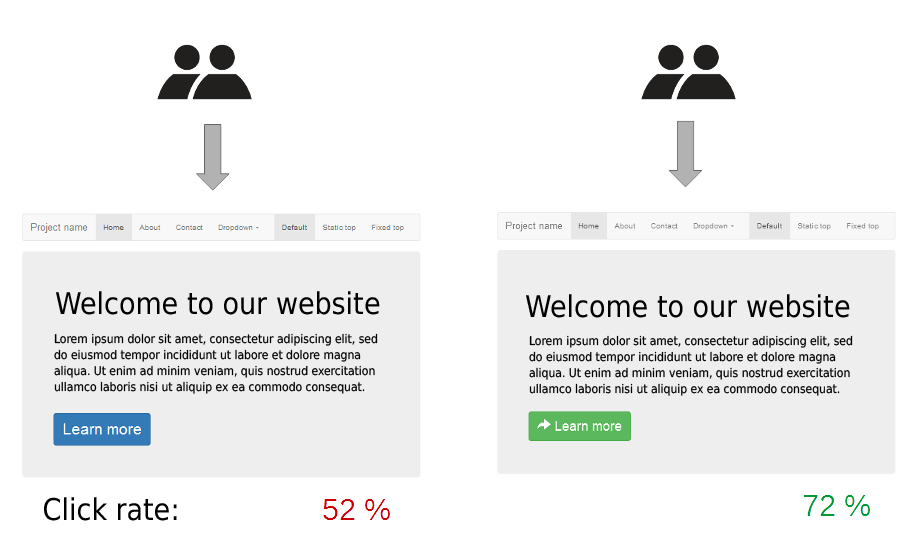

Допустим, специалист предполагает, что изменив цвет конверсионной кнопки с нейтрального голубого на агрессивный красный, он сделает ее более заметной. Чтобы проверить, приведет ли это к увеличению продаж и росту конверсии, маркетолог создает усовершенствованный вариант веб-страницы (B, новая страница).

Чтобы проверить, приведет ли это к увеличению продаж и росту конверсии, маркетолог создает усовершенствованный вариант веб-страницы (B, новая страница).

С помощью инструментов для проведения сплит-тестирования эксперт в случайном порядке разделяет трафик между страницами A и B на две приблизительно равные части. Условно говоря, половина посетителей попадает на страницу A, а вторая половина на страницу B. При этом маркетолог держит в уме источники трафика. Чтобы обеспечить валидность и объективность тестирования, необходимо направить на страницы A и B по 50% посетителей, пришедших на сайт из социальных сетей, естественного поиска, контекстной рекламы и т.п.

Собрав достаточно информации, маркетолог оценивает результаты тестирования. Как сказано выше, коэффициент конверсии страницы A составляет 2%. Если на странице B этот показатель составил 2,5%, значит изменение конверсионной кнопки с голубого на красный цвет действительно увеличило эффективность лэндинга. Однако показатель конверсии не достиг желаемых 4%.

Что тестировать

Как отмечалось выше, сплит-тестирование — это прикладной метод, позволяющий влиять на различные метрики сайта. Поэтому выбор объекта тестирования зависит от цели и задач, которые ставит перед собой маркетолог.

Например, если показатель отказов посадочной страницы составляет 99%, при этом большинство посетителей покидает лэндинг в течение 2-3 секунд после «приземления», стоит задуматься об изменении визуальных компонентов страницы. С помощью A/B-теста маркетолог может найти оптимальный вариант макета страницы, выбрать привлекательную цветовую гамму и изображения, использовать читабельный шрифт. А если перед маркетологом стоит задача увеличить количество подписок, он может попробовать изменить соответствующую конверсионную форму. Сплит-тест поможет специалисту выбрать оптимальный цвет кнопки, лучший вариант текста, количество полей в форме подписки или ее расположение.

Чаще всего маркетологи тестируют следующие элементы веб-страниц:

- Текст и внешний вид конверсионных кнопок, а также их расположение.

- Заголовок и описание продукта.

- Размеры, внешний вид и расположение конверсионных форм.

- Макет и дизайн страницы.

- Цену товара и другие элементы бизнес-предложения.

- Изображения товаров и другие иллюстрации.

- Количество текста на странице.

Какие инструменты сплит-тестирования использовать

Чтобы выполнить A/B-тестирование, маркетологу необходимо воспользоваться одним из специализированных инструментов. Один из наиболее востребованных – сервис Google «Оптимизация» (до августа 2019 назывался Content Experiments), который является теперь частью новой платформы для маркетологов Google Marketing Platform. С его помощью можно тестировать элементы страниц, включая заголовки, шрифты, конверсионные кнопки и формы, изображения и т.

Также можно использовать для проведения сплит-тестирования следующие инструменты:

- Optimizely — наиболее популярный в «буржунете» платный сервис A/B-тестирования. Стоимость его использования не публикуется – для уточнения нужно связаться с отделом продаж. К преимуществам относится возможность создания экспериментов в визуальном интерфейсе, что избавляет маркетолога от необходимости работать с HTML-кодом тестируемых страниц.

- Visual Website Optimizer — платный сервис, позволяющий тестировать различные элементы страницы. Чтобы использовать этот инструмент, маркетологу необходимо иметь навыки работы с HTML-кодом. Стоимость месячной подписки VWO составляет от 99 до 999 долларов.

- Unbounce – сервис, предназначенный для создания и оптимизации лэндингов. В том числе он позволяет выполнять A/B-тестирование. Стоимость использования составляет от 79 до 399 и более долларов в месяц.

Как провести A/B-тестирование с помощью Google Optimize

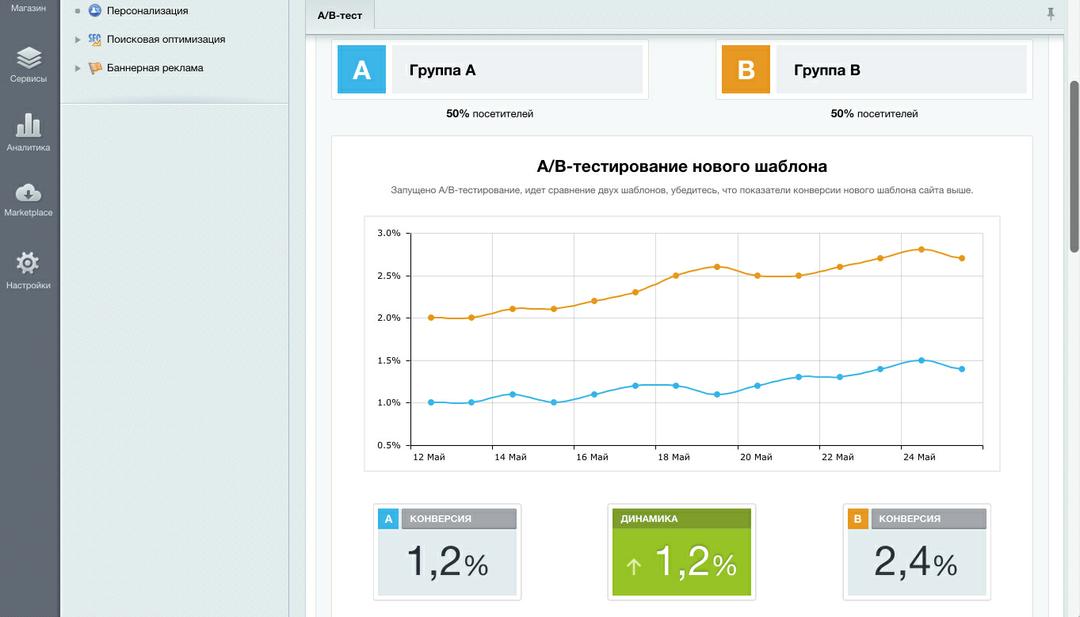

Сервис «Оптимизация» Google Marketing Platform позволяет одновременно проверить эффективность пяти вариантов страницы. Используя его, можно проводить A/B/N-тестирование, которое отличается от стандартных A/B-экспериментов проверкой сразу несколько гипотез вместо двух.

Маркетолог имеет возможность самостоятельно определять долю трафика, участвующего в тестировании. Минимальная продолжительность теста составляет две недели, максимальная ограничена тремя месяцами. Результаты можно наблюдать в личном кабинете или получить по e-mail.

Чтобы провести сплит-тестирование с помощью «Оптимизации» сделайте следующее:

- Войдите в аккаунт Google Marketing Platform, откройте сервис «Оптимизация» и создайте свой первый проект. Дайте ему название, укажите URL базовой страницы, копии которой будут тестироваться и выберите режим «Эксперимент A/Б».

- Зайдите в созданный проект и продолжайте его настройку в соответствии с планом, предлагаемым в подсказке. Последовательно выполните все пункты от 1 до 5.

- Сначала создайте экспериментальные варианты и добавьте правила таргетинга. Для работы установите в браузер Chrome расширение «Оптимизация» из официального магазина Google. Оно позволяет визуально отредактировать изменения на страницах.

- Укажите, при переходе на какие URL пользователь будет видеть измененные варианты страницы. Можно задать несколько условий проверки. Главное, не забыть их сразу протестировать, чтобы не было ошибки.

- Настройте целевую аудиторию. Например, изменения на странице будут показаны только посетителям из Москвы.

- Выберите стандартные или создайте собственные цели эксперимента. Они должны быть связаны с Google Аnalitics.

Например, нас может заинтересовать в виртуальном эксперименте, как зависит количество просмотренных статей блога от цвета фона заголовка h2 на главной. Исследуем, серый или фисташковый?

Например, нас может заинтересовать в виртуальном эксперименте, как зависит количество просмотренных статей блога от цвета фона заголовка h2 на главной. Исследуем, серый или фисташковый?

- Все готово, осталось только создать код эксперимента и вставить его на страницу. Если непонятно как это сделать, можно выбрать опцию «Отправить код веб-мастеру» или сделайте это самостоятельно. Но для этого нужно немного разбираться в HTML.

Еще важный момент – определить, какая часть трафика будет участвовать в эксперименте. По умолчанию используется все 100 %, а если у вас, как у «Текстерры», миллион уникальных посетителей в месяц – вполне хватить и 20–30 тысяч. А значит, выбираем 3 %.

- Если все сделано правильно, в меню появится сообщение о том, что проект готов к запуску и будет разблокирована кнопка «Ок».

Вы сможете оценить первые результаты тестирования через несколько суток после начала эксперимента. Чтобы следить за результатами тестирования, выберите соответствующий эксперимент в списке и перейдите на страницу отчетов.

Чтобы следить за результатами тестирования, выберите соответствующий эксперимент в списке и перейдите на страницу отчетов.

Идеи, эффективность которых стоит обязательно проверить с помощью A/Б-тестирования

Мы уже говорили, что тестирование помогает увеличить эффективность веб-страниц. Чтобы этот метод принес результат, маркетолог должен генерировать идеи, способные позитивно влиять на те или иные метрики сайта. Нельзя просто брать какие-либо изменения с потолка, внедрять их и тестировать эффективность. Например, вряд ли метрики сайта изменятся, если вы просто решите изменить фон заголовка главной страницы, как в прошлом примере.

Маркетолог должен видеть способы улучшения страниц и понимать, почему они должны сработать. Cплит-тестирование просто помогает проверить предположения специалиста. Однако каждый маркетолог иногда оказывается в ситуации, когда все идеи проверены, а необходимого результата достичь не удалось. Если вы попали в такую ситуацию, попробуйте внедрить следующие изменения и проверить их эффективность:

- Используйте конверсионную форму, которая остается перед глазами посетителя при прокрутке страницы.

Например, эта форма может быть неподвижно «прикручена» к верхней части экрана, как навигационное меню Facebook.

Например, эта форма может быть неподвижно «прикручена» к верхней части экрана, как навигационное меню Facebook.

- Удалите лишние поля из конверсионной формы. Возможно, ваши потенциальные подписчики не хотят раскрывать свои паспортные данные.

- Опубликуйте на посадочной странице видео. Обычно это позитивно влияет на ряд метрик, включая показатель отказов, коэффициент конверсии и время пребывания на странице.

- Увеличьте срок, в течение которого пользователи могут бесплатно тестировать ваш продукт. Это простой и эффективный способ увеличения конверсий для компаний, продающих ПО и веб-сервисы.

- Экспериментируйте с цветом конверсионных кнопок. В некоторых случаях хорошо работают кнопки агрессивного красного цвета. Однако иногда они раздражают пользователей. Используйте A/B-тест, чтобы найти наиболее эффективный цвет кнопки для вашего сайта.

- Пообещайте бонусы первым 10 или 100 покупателям (подписчикам).

Не спешите удалять это обещание даже после завершения акции. Многие пользователи не рассчитывают войти в число счастливчиков, однако все равно подсознательно реагируют на выгодное предложение.

Не спешите удалять это обещание даже после завершения акции. Многие пользователи не рассчитывают войти в число счастливчиков, однако все равно подсознательно реагируют на выгодное предложение.

Как и зачем тестировать разные варианты страниц

A/Б тестирование позволяет оценить эффективность изменений веб-страниц. Этот маркетинговый метод имеет прикладное значение. Он позволяет практически постоянно совершенствовать страницы, улучшая различные метрики.

Чтобы протестировать то или иное изменение, необходимо создать новый вариант страницы и сохранить старый. После этого следует воспользоваться одним из сервисов для проведения экспериментов, например, «Оптимизацией» Google. Оценку результатов можно проводить как минимум через две недели после его запуска.

что это такое, этапы, ошибки и инструменты

Нельзя на авось запускать кампании и креативы, надеясь на приток конверсий и заявок. Работая так, вы рискуете стабильно терять время и деньги. А мы здесь для того, чтобы зарабатывать. Разумнее проверить гипотезы, а уже потом пускать все в работу. Для таких целей часто используют A/B-тестирование.

А мы здесь для того, чтобы зарабатывать. Разумнее проверить гипотезы, а уже потом пускать все в работу. Для таких целей часто используют A/B-тестирование.

В этой статье мы раскроем суть A/B-тестирования. Расскажем, что это, зачем, кому нужно, и какими инструментами пользоваться, а также разберем ошибки маркетологов.

Что такое A/B-тестирование и зачем оно нужно

A/B-тестирование — эксперимент, в ходе которого из двух (или более) предложенных переменных выбирают наиболее эффективную.

Чаще всего при A/B-тестировании берут один объект и сравнивают, какая из переменных в нем вызывает больше положительных откликов у аудитории. В качестве переменных выступают тексты, визуал, таргетируемая аудитория, оффер и т.д. С помощью теста вы поймете, какие изменения положительно влияют на результат.

Итог A/B-тестирования — запуск того варианта рекламы, всплывающих окон, текста, кнопок и т.д, которые по результатам анализа работают эффективнее других.![]()

Зачем делают A/B-тестирование

Экономия времени и ресурсов. Чтобы переделать лендинг или рассылку, которые вас не удовлетворили, придется подключить всю команду и потратить немало времени и ресурсов. Куда проще и быстрее сделать A/B-тест гипотез, увидеть результат через пару недель и внести одно изменение вместо полной переделки продукта.Читайте также:

Эффективная реклама в интернете: где ее разместить, как оценить и повысить основные показатели

Стабильный ROI. A/B-тест повышает эффективность выбранных каналов без крупных дополнительных затрат, а его результаты станут ориентиром для корректировок. Отсюда вытекает следующее преимущество. Уверенность в эффективности изменений. Результаты A/B-теста — конкретные измеримые данные и статистика, которыми вы будете руководствоваться в дальнейшем. Цифры — куда более крепкий аргумент, чем интуиция.

Результаты A/B-теста — конкретные измеримые данные и статистика, которыми вы будете руководствоваться в дальнейшем. Цифры — куда более крепкий аргумент, чем интуиция.

Меньше рисков. Если вы резко начнете менять рассылку, кампании или сайт, вы рискуете сломать то, что работало и спугнуть клиентов. Точечные исправления на основе теста чинят именно те вещи, которые не работают. Быстро, без кардинальных перестановок. А значит, с меньшими рисками.

Меньше отказов. Люди покидают сайт или не реагируют на рассылки и рекламу по разным причинам. В результате A/B-теста вы исключаете те вещи, которые побуждали людей отказывать. И чем дальше и эффективнее аналитика клиентского опыта, тем у них меньше поводов отказывать вам.

Инсайты. Одно дело — строить гипотезы в переговорке, а другое — увидеть реальную картину мира. С A/B-тестами вы поймете аудиторию и узнаете, что ей нравится на самом деле. На основе этой информации вы можете не только корректировать один объект, но и выстраивать полноценные кампании.

Читайте также:

Как привлечь новых клиентов для бизнеса? Разбираемся с лидогенерацией

Резюмируя, A/B-тест положительно влияет на пользовательский опыт, что закономерно улучшает показатели и повышает эффективность рекламы.Что проверяют с помощью A/B-тестирования

Номинально, такой тест применяют ко всему, что может повлиять на поведение пользователей. К примеру, стриминговый сервис Netflix с помощью теста настраивает персональную страницу с рекомендациями для каждого пользователя, показывая в топе то, что согласно данным, с большей вероятностью посмотрят.Однако существуют вещи, для проверки эффективности которых A/B-тест используют чаще. Среди них:- заголовки, темы писем — первое, что видит человек.

А значит, они определяют, пойдет ли посетитель дальше, либо пропустит вас мимо.

А значит, они определяют, пойдет ли посетитель дальше, либо пропустит вас мимо. - изображения, анимация, видео — визуал вызывает разные эмоции у каждого человека. Ваша задача — найти то, что что приятнее ключевой аудитории.

- верстка контентных блоков на странице или в письмах — в результате теста вы добьетесь, чтобы все элементы органично дополняли друг друга и акцентировали внимание на том, что приведет к конверсионному действию.

- тексты — узнайте, какой текст лучше описывает пользу и то, как вы решите проблему клиента.

- каналы коммуникации — проверьте, на какой из площадок больше лояльной и вовлечённой аудитории, а от какой лучше отказаться и не тратить силы и бюджет.

- всплывающие окна — поп-апы часто раздражают, поэтому тест поможет найти тот вариант окна, который вызовет меньше негатива у пользователей.

- лид-магниты — в основе лид-магнитов лежит польза для клиента, с помощью теста вы узнаете, какой магнит лучше работает.

- скидки и предложения — узнайте, какие предложения на самом деле интересуют вашу аудиторию. Вдруг вы найдете что-то более полезное и выгодное, чем скидки.

- тексты на кнопках, CTA — последняя ступень перед совершением целевого действия. С помощью A/B-теста вы найдете то сочетание призыва к действию, цветов и форм кнопки, которое побудит человека к клику.

Инструменты для A/B-тестирования

Прелесть A/B-теста не только в его наглядности и простоте, но и в том, что существует готовое решение для проверки практически любого формата: от элементов на сайте до рассылок. То есть вам не понадобятся специальные знания или услуги агентств. Рассмотрим детально.

Калькулятор достоверности A/B-тестирования от Яндекса

Простой, бесплатный и универсальный инструмент. Онлайн-калькулятор наглядно сравнивает результаты эксперимента и выносит вердикт рекламным стратегиям. Занесите данные по конверсиям, кликам и расходам, кликните по кнопке «Рассчитать» — и всё. Подробный отчет анализа можно скачать в виде файла Excel.

Подробный отчет анализа можно скачать в виде файла Excel. Google Optimize

Сервис помогает протестировать интерфейс сайта — можно сравнивать посадочные страницы, проверять эффективность элементов дизайна, контент. Указывайте цели, аудиторию, сроки эксперимента, синхронизируйте с Google Аналитикой и смотрите за результатами теста в реальном времени.A/B-тестирование всплывающих окон и других инструментов повышения конверсии от Callibri

В МультиЧат Callibri включен набор инструментов для повышения конверсии сайта. В том числе речь идет о всплывающих окнах, вовлекающих в чат крючках и квизах. Каждый из инструментов вы можете протестировать прямо в личном кабинете. Включите режим A/B-теста, задайте варианты и проверяйте, какое окно, квиз или крючок привлекает больше конверсий. Отчеты покажут всю информацию.Встроенное А/B-тестирование заголовков письма и аудиторий от eSputnik

Сервис предлагает запустить сплит-тест уже на этапе создания рассылки. Вы можете указать несколько вариантов заголовков письма и сразу после запуска посмотреть, какой из них сработал лучше. В сервисе можно проводить и более глобальные эксперименты — протестировать баннеры, кнопки и анимацию. Для этого разделите аудиторию на группы и отправьте им разные варианты писем, результаты теста можно оценить минимум через сутки после запуска.

В сервисе можно проводить и более глобальные эксперименты — протестировать баннеры, кнопки и анимацию. Для этого разделите аудиторию на группы и отправьте им разные варианты писем, результаты теста можно оценить минимум через сутки после запуска.A/B-тестирование объявлений Facebook

Все действия происходят в Facebook Ads Manager. Здесь вы можете разделить аудитории на группы и проверять, какая из них лучше реагирует на ваши объявления и конкретные переменные. Процесс A/B-тестирования занимает от 3 до 14 дней. Ещё соцсеть дает тестировать:- места размещения,

- группы товаров,

- креативы,

- пользовательские переменные,

- оптимизации показа.

Сервис A/B-теста Realroi.ru

Сервис RealROI предлагает протестировать интернет-страницы, лендинги и сайты целиком. Выбирайте объект теста, будь то картинки, тексты или структура, а затем следите за данными по конверсии в реальном времени.

Выбирайте объект теста, будь то картинки, тексты или структура, а затем следите за данными по конверсии в реальном времени. Частые ошибки при A/B-тестировании

Как и любой инструмент, A/B-тест требует осознанного подхода. Если этого не будет, неизбежны ошибки, которые сведут на нет любой эксперимент. Где оступаются маркетологи, делая A/B-тесты?

Запуск теста без четкой гипотезы. Корректно формулируйте гипотезы до запуска теста. Экспериментируя без четко поставленной гипотезы, вы рискуете получить неверные данные и начать исправлять те вещи, которые этого не требовали. Проведите анализ, поймите, что не работает и предложите варианты решения. Только после этой предварительной работы A/B-тест имеет смысл.Читайте также:

Как сделать анализ целевой аудитории для запуска рекламной кампании. 3 метода и советы по работе с данными

Слишком много вариантов. Задавая излишнее количество переменных для теста, вы рискуете не узнать, что конкретно влияет на конверсию. Ведь в разной степени на нее влияет всё. Не рассеивайте внимание и четко расставляйте приоритеты, чтобы получить больше точных данных. Тестируйте 2 варианта рассылки или креатива в один момент. Помните, что чем больше переменных, тем ниже точность теста.Неверный срок теста. Не важно, слишком долго или слишком мало шел тест — эксперимент неудачен в обоих случаях. Определите одинаковый временной отрезок, который покажет наиболее корректные данные по конверсиям переменных. К примеру, Facebook предлагает окно от 3 до 14 дней. Очевидно, что 3 дня может не хватить, а вот хотя бы неделю выделить на тест стоит.

Неверная оценка внешних факторов по трафику. Если вы тестируете один вариант в тот период, когда на сайт идет больше всего трафика, а другой — в период затишья, то результаты теста использовать нельзя. Сезон отпусков, праздники, распродажи, любой период перепада трафика — не лучшее время для A/B-теста.

Игнорирование статистики в пользу собственных ощущений. Отпустите собственные прогнозы и доверьтесь цифрам в отчетах. Даже низкие показатели говорят о том, что нужно взять новый курс, а не отказываться от инструмента. Запускайте каждый тест на основе данных предыдущего и продолжайте улучшать результаты, пока статистика не удовлетворит вас. А затем снова продолжайте 🙂

Заключение

A/B-тестирование — простой и наглядный инструмент, который помогает корректировать сайты и рекламу без больших трудов и затрат. Главное следовать простому алгоритму эксперимента:

- Поставьте цель;

- Выдвиньте гипотезы;

- Определите варианты корректировок для достижения цели;

- Протестируйте переменные;

- Проанализируйте результат. К примеру, помощью одного из вышеописанных инструментов и метрик;

- Запускайте самый эффективный вариант в работу.

Помните, что только руководствуясь данными аналитики и действуя последовательно, вы извлечете пользу из любого исследования. A/B-тест — не исключение.

В каких случаях можно не проводить АБ-тесты

Как появились АБ-тесты, в каких ситуациях АБ-тестирование бесполезно и как определить лучший вариант лендинга или рекламы без тестирования.

Что такое АБ-тесты и причём тут пивоварение

АБ-тестирование — сравнение двух, реже — более двух, вариантов сайта, дизайна, офферов компании для определения наиболее эффективной версии. Варианты могу отличаться одним элементом, например, расположением заголовка или цветом кнопки, или совершенно отличаться друг от друга. По итогам тестирования выбирают лучшую альтернативу, например, страницу с максимальной конверсией в заявки и продажи.

Подробнее о том, что такое АБ-тестирование и как оно помогает увеличить продажи, читайте в нашем блоге.

АБ-тестирование началось с пива: основе АБ-тестирования лежит статистический анализ. Его развивал британский учёный Уильям Сили Госсет, в начале XX века работавший в компании Guinness.

Госсет хотел найти способ улучшить отбор сырья для пивоварения. Для этого он разработал математическое обоснование «закона ошибок» для малых статистических выборок. Сегодня его открытие известно как «t-распределение Стьюдента», которое и легло в основу концепции статистической значимости.

На основе статистических данных принимаются многие решения — от оценки эффективности политической кампании до оттенка синего цвета для гиперссылок на сайте.

Когда АБ-тесты бесполезны: парадокс Фредкина и закон тривиальности Паркинсона

Идеи в основе АБ-тестов содержат парадокс, который может поставить под сомнение ценность полученных данных.

Парадокс Фредкина. Чем больше два одинаковых варианта кажутся одинаково привлекательными, тем сложнее сделать выбор между ними. Из-за парадокса Фредкина выбор между двумя очень похожими вариантами не будет иметь ценности. Нет смысла запускать АБ-тестирование, чтобы определить какая кнопка — тёмно-синяя или светло-синяя — принесёт больше заявок.

Закон тривиальности Паркинсона. В 1955 году К. Норткот Паркинсон описал в своей книге вымышленную встречу, на которой 11 человек принимали решение о строительстве атомной электростанции и навеса для велосипедов. Из-за сложности вопроса только двое участников могли принять участие в обсуждении бюджета на строительство электростанции, который оценивался в $10 000 000. Через две минуты бюджет был утверждён. Обсуждение строительства навеса для велосипедов, стоимостью $2 350, заняло 40 минут, все присутствующие принимали активное участие в обсуждении.

Так Паркинсон показал, что время, затраченное на любой пункт повестки дня, будет обратно пропорционально затраченной денежной сумме. То есть зачастую на неважные решения затрачивается слишком много времени и денег. Поэтому иногда проведение АБ-теста не будет иметь ценности по сравнению с усилиями, которые будут потрачены на его проведение.

О том, какие ошибки мешают принимать правильные решения по итогам АБ-тестирования, рассказали в нашем блоге.

Альтернатива АБ-тестам

Проведение АБ-тестов может быть сложным и затратным. Создание второго, тестового варианта, может составлять половину суммы, которую компания потратила на создание первой версии. Поэтому АБ-тестирование стоит проводить только для проверки серьёзных изменений.

Как без АБ-тестов можно определить лучший вариант?

1. Проанализируйте действия пяти пользователей. Первые пять посетивших сайт пользователей обнаруживают более 75% проблем, связанных с простотой и удобством использования страницы. Проанализируйте их поведение — поймёте, как улучшить сайт без АБ-тестирования.

2. Вносите только одно простое изменение. Просто внесите это изменение и посмотрите, что произойдёт. Вместо того, чтобы показывать половине пользователей изменённый заголовок главной страницы и ждать статистически значимых результатов, покажите всем посетителям сайта новый вариант — получите результаты гораздо быстрее. Если страница станет хуже конвертировать посетителей в заявки, откатите её до старого варианта.

Такой способ не имеет такую статистическую точность как A/Б-тестирование, но он упрощает принятие решения о небольших изменениях.

3. Используйте сервис «А/Б-тесты» Roistat. В Roistat можно быстро настроить тестирование: поменять цвет кнопки или варианты главного меню без помощи программистов. Сервис сравнит, сколько заявок, продаж, выручки и прибыли принёс каждый вариант. При необходимости можно добавить другие важные для бизнеса показатели.

Пример отчёта в сервисе «А/Б-тесты» RoistatКогда A/Б-тест принесёт пользу

Когда нужно проверить гипотезу в сжатые сроки. Например, если вы готовите лендинг к распродаже или мероприятию, и нужно быстро принимать решения. A/Б-тест поможет принимать обоснованные решения и быстро устранять проблемы, связанные с удобством и простотой работы с сайтом.

Когда вы рискуете потерять большую сумму денег, если не протестируете гипотезу. Например, если Amazon изменит цвет кнопки на форме заказа, не проведя АБ-тестирование, компания рискует потерять миллионы долларов за минуту: пользователи просто не поймут, как завершить заказ, и уйдут с сайта.

В таком случае АБ-тест снижает уровень возможных потерь и обеспечивает уверенность в том, что выбор был сделан правильно.

На нашем Telegram-канале делимся полезными материалами по маркетингу и аналитике, кейсами клиентов, собираем познавательные дайджесты и анонсируем бесплатные обучающие вебинары. Подписывайтесь, чтобы ничего не пропустить!

Онлайн-курс Теплицы: «Как НКО проводить A/B-тестирование сайтов»

Иллюстрация: Ксения Горшкова.Команда Теплицы социальных технологий приглашает сотрудников некоммерческих организаций принять участие в онлайн-курсе «Как НКО проводить A/B-тестирование сайтов». Онлайн-курс пройдет с 24 по 27 августа 2021 года.

Слушатели курса научатся проводить А/В-тестирование и работать с инструментами Google Tag Manager, Google Optimize и Google Analytics.

О курсе

A/B-тестирование — метод, который позволяет понимать поведение пользователей на сайте и влиять на него через изменение элементов дизайна.

Команды небольших фондов с помощью A/B-тестирования сайта и страниц для пожертвований смогут собирать больше средств. Сотрудники малых фондов на курсе углубят знания по Google Analytics и поймут, как в дальнейшем достигать целей.

За четыре дня курса участники смогут подготовиться к запуску теста и запустить его. Иногда для запуска A/B-теста фондам нужна помощь программистов. На курсе мы рассмотрим варианты, когда можно разобраться с технической частью самостоятельно и когда стоит обратиться к IT-специалисту.

Если у вас не подключена Google Analytics до старта курса, то, пожалуйста, подключите ее для эффективного обучения.

Ведущая курса

Екатерина Булгакова,координатор проектов благотворительной организации «Ночлежка»Как устроен онлайн-курс

Курс будет состоять из четырех вебинаров и начнется 24 августа 2021 года. Вебинары будут проходить каждый день с 11:00 до 12:15 по московскому времени. Курс завершится 27 августа 2021 года.

Слушатели, успешно сдавшие финальный тест, получат сертификаты о прохождении курса. Это бесплатный курс.

Темы и даты вебинаров

Вебинар № 1: Как сформулировать гипотезу для А/В-теста

На первом вебинаре Екатерина Булгакова расскажет, что такое А/В-тест и как формулировать гипотезу для проведения эксперимента.

Дата: 24 августа 2021 года с 11:00 до 12:15 (по мск).

Вебинар № 2: Инструменты для проведения А/В-теста

На втором вебинаре мы поговорим о работе с Google Tag Manager, Google Analytics, Google Optimize. Участники ознакомятся с каждым инструментом, узнают, как связать Google Optimize с Google Analytics и зачем нужен сниппет Anti-Flicker.

Дата: 25 августа 2021 года с 11:00 до 12:15 (по мск).

Вебинар № 3: Как настроить первый эксперимент

На третьем вебинаре Екатерина расскажет о правилах таргетинга и пошагово покажет, как настраивать эксперимент в Google Optimizer.

Дата: 26 августа 2021 года с 11:00 до 12:15 (по мск).

Вебинар № 4: Оценка эффективности эксперимента

На четвертом вебинаре мы остановимся на теме анализа результатов А/В-теста и оценке их значимости. Также часть вебинара будет посвящена ответам на вопросы тех участников, кто попробовал запустить эксперимент в течение курса.

Дата: 27 августа 2021 года с 11:00 до 12:15 (по мск).

Как получить сертификат

Для получения сертификата об успешном прохождении курса необходимо успешно пройти финальное задание.

Где учимся

Вебинары пройдут в сервисе Zoom. Ссылку на подключение вы получите в письме после регистрации. Вопросы по курсу вы можете задать Марии Борисёнок по почте [email protected]

Эти [17 ошибок] «похоронят» ваш A/B тест — CMS Magazine

Большинство A/B экспериментов делаются неправильно. Это правда. Вполне возможно и ваш последний эксперимент был сделан неправильно. А вы тут сейчас сидите и радуетесь, не подозревая о последствиях.

Кто из вас до старта эксперимента использовал сервисы, которые позволяют посчитать минимальное количество конверсий для получения достоверных результатов? Сомневаюсь, что вас много.

Серьёзно. У большинства, A/B тестирование — это лишь запуск эксперимента. Никакого анализа. Никаких гипотез. Поменял цвет кнопки и сидит довольный. Ждёт роста продаж, понимаешь ли.

Реальность не так сладка, дружок. Всё жёстче, чем ты думаешь. Большинство экспериментов делаются неправильно. Кругом одни и те же ошибки. Ошибки ведут к неправильным результатам. Неправильные результаты — к неправильным выводам. Неправильные выводы — к разочарованиям в самом A/B тестировании или даже убыткам.

И всё становится на свои места: никаких новых и эффективных инструментов улучшения сайта. Всё как обычно. Влил деньги в трафик. Получил посетителей. Заработал свою копейку. И счастлив.

Ну что, приступайте к поиску своих ошибок. Я долго собирал их все. Чтоб вас хоть слегка озарило.

A/B тестирование без гипотезыК чему это приводит?

Большинство A/B тестов обречены на неудачу. Случайное тестирование бессмысленно. В 90 % случаев вы просто потратите время зря. И в итоге вообще перестанете проводить эксперименты, так как они не будут приносить положительных результатов.

Что делать?

Ставить поиск гипотезы на первое место в A/B тестировании. Сначала гипотеза — потом эксперимент. И никак иначе.

Для поиска гипотезы можно использовать разные варианты. К самым распространенным и эффективным способам относятся:

— Анализ количественных показателей сайта в Google Analytics и Яндекс.Метрике (Например, поиск самых посещаемых страниц с высоким показателем отказов/выходов, поиск посещаемых страниц с самым низким показателем конверсии).

— Анализ карты кликов, карты скроллинга, карты ссылок, вебвизора (Это даст понимание, на какие элементы жмут посетители, на что они обращают внимание, как глубоко листают страницу, как взаимодействуют с сайтом). Весь перечисленный функционал есть в Яндекс.Метрике и Hotjar.

— Проведение опросов потенциальных и текущих клиентов (Встраивание опросов прямо на сайт с помощью Qualaroo, Hotjar и других сервисов, опросы через E-mail рассылки, личное общение с целевой аудиторией).

— Анализ общения посетителей со службой поддержки и менеджерами по продажам через онлайн-консультанты или E-mail.

— User-testing — проведение пользовательских тестов с целевой аудиторией, начиная с захода на сайт и заканчивая совершением главного целевого действия (Можно сделать это лично либо с помощью сервисов Askusers.ru, Userpoint.ru или Usertesting.com (Guru99).

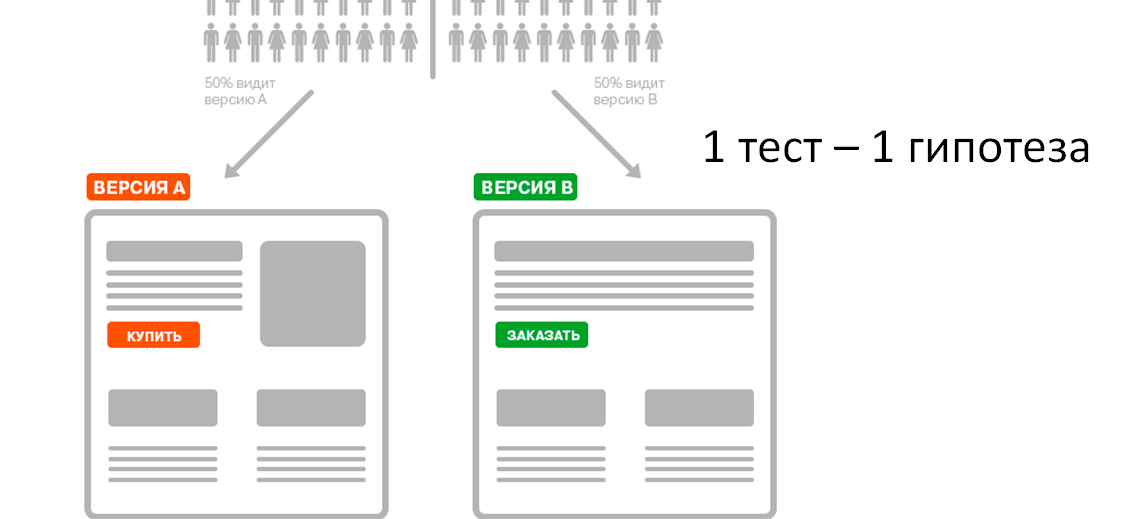

A/B тестирование сразу нескольких элементовК чему это приводит?

Эксперимент заканчивается. Статистика собрана. Положительный или отрицательный результат есть. Но!

Ничего непонятно.

Откуда он взялся? Изменение, какого элемента, повлияло на конверсию? Именно таков итог подобных A/B тестов.

По каким причинам возникает эта проблема?

Либо нет обоснованной идеи для эксперимента, либо хочется сделать всё быстро и за 1 раз. Оба варианта ужасны. О важности идеи сказано в первом пункте. О скорости и говорить не стоит. A/B тестирование — это не такая штука, которую сегодня запустил, а завтра получил результат.

A/B тестирование — это систематический и последовательный подход к улучшению эффективности сайта. Он даёт результаты не сразу. Но, если делать всё правильно, то положительный результат будет.

Что делать?

Придерживайтесь одного простого правила: 1 эксперимент — 1 гипотеза. Проще некуда. Не нужно придумывать велосипед и пытаться «извратить» A/B тестирование. Вам будет только хуже от этого.

Проанализировали сайт, поведение пользователей, пообщались с ними > составили список идей для тестирования > расставили их по приоритетам (простоте реализации и вероятности влияния на конверсию) > начали последовательно тестировать гипотезы одну за другой (при этом после проведения каждого эксперимента делайте соответствующие выводы)

Преждевременное окончание экспериментаК чему это приводит?

К неправильным выводам, в результате чего реализуется как бы победивший вариант, но уже через неделю/две/месяц происходит снижение конверсии. Очень велика вероятность такого исхода.

Пример:

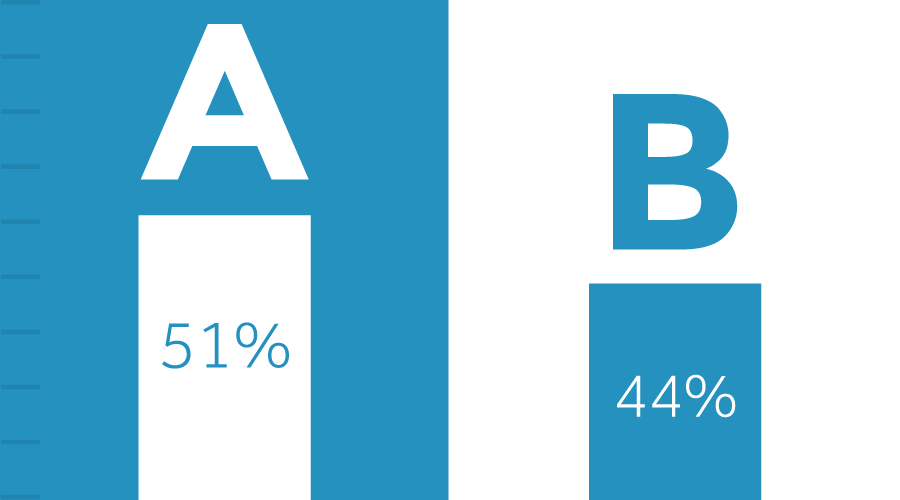

Проводился A/B тест на сайте с небольшим количеством трафика и конверсий. Через 2 дня результаты были такими:

Конверсия в оригинальном варианте (Control) — 8.66. Конверсия в тестовом варианте (Variation 1) — 0.91. В этот момент «неопытный» интернет-маркетолог или клиент с пеной у рта будут требовать остановить эксперимент. Ведь всё очевидно. Но матёрый спец по увеличению конверсии умён. Он никогда так не поступит.

Результат через 10 дней после начала эксперимента:

Конверсия в тестовом варианте — 17.10 %. Конверсия в оригинальном варианте — 13.66 %. Так было ли всё настолько очевидно через 2 дня? Надеюсь, теперь вы понимаете, почему нельзя останавливать эксперимент раньше времени.

Конечно, это очень радикальный кейс: 11 против 1 конверсий через 2 дня. Но если будет 30 против 10, то «зелёный» интернет-маркетолог может поступить точно так же.

Что делать?

Не останавливать эксперимент при первых значительных результатах. В примере выше на 2-ой день было все 11 конверсий в оригинале, и 1 конверсия в тестовом варианте. Делать выводы на основе такой выборки нельзя!

На каждом варианте страницы должно быть как минимум 100 конверсий. Об этом говорят зарубежные эксперты. На мой взгляд, даже этого мало. Чем больше выборка, тем достовернее результаты. Поэтому не торопитесь.

Это одно из базовых правил.

Советую также использовать специальные калькуляторы, которые помогают понять, сколько нужно конверсий для получения достоверного результат. В этом калькуляторенужно ввести текущий показатель конверсии и минимально необходимое увеличение конверсии. Хотя это даже не совет. Это нужно делать обязательно!

Лайфхак: Не лезьте в аналитику в первые дни запуска A/B теста: не будет соблазнов остановить его раньше времени.

A/B тест проводится меньше неделиК чему это приводит?

Это приводит ко всем проблемам, которые описаны в предыдущем варианте.

Почему так происходит?

Потому что поведение посетителей отличается в разные дни недели. Это доказанный факт. Подтверждение ниже:

Это статистика известного интернет-магазина. Данных вполне достаточно, чтобы сделать достоверные выводы. В четверг и пятницу конверсия гораздо выше, чем в субботу.

Что делать?

Проводить A/B тесты минимум 7 дней. Лучше даже 14. При этом нужно также учитывать длительность цикла продажи. Если с момента первого знакомства с товаром и до его покупки проходит 10 дней, то и эксперимент должен длиться не меньше этого периода.

Это такое же базисное правило. Если не собираетесь соблюдать его, то вообще лучше не беритесь за A/B тестирование

Очень хорошо об этом написали ребята из Retail Rocket

На скриншоте ниже видно, что почти 7 % посетителей интернет-магазина принимают решение в течение 7-13 дней, прежде чем совершить покупку.

Таким образом, цикл продажи для некоторых составляет 7-13 дней. А ещё 2.5 % пользователей думают больше 14 дней.

Если запустить A/B тест в таком интернет-магазине и остановить его на 6-ой день, то около 10 % всей аудитории не попадёт в него. Соответственно результаты будут не максимально достоверными.

Игнорирование статистической достоверностиК чему это приводит?

К неправильным выводам. Всё, как и в двух предыдущих пунктах.

Что делать?

Не полагаться на результаты эксперимента, если статистическая достоверность меньше 95 %. 95 % — это минимальная планка. В идеале, этот показатель должен быть 99.9 %.

Несмотря на то, что во всех сервисах для A/B тестирования есть встроенные алгоритмы расчёта статистической достоверности, многие игнорируют их. А потом это игнорирование приводит к проблемам на сайте.

Зарубежные специалисты по увеличению конверсии советуют дополнительно использовать калькуляторы расчёта статистической достоверности. Можете воспользоваться этим сервисом

Три последних пунктах — количество конверсий, длительность теста и статистическая достоверность — это базовые правила. Обязательно соблюдайте их при A/Bтестировании.

Тестирование элементов, которые не влияют на конверсиюК чему это приводит?

Такие эксперименты не имеют никакого смысла. Изменяя элементы, которые не влияют на принятие решений, вы не сможете воздействовать на поведение пользователей.

Если вы изменяете текст, который никто никогда не читал или меняете элемент в нижней части посадочной страницы, которую видят только 10 % пользователей, то никакого толка не будет.1

Если вы цените своё время и деньги, то не тратьте время на бессмысленные A/B тесты.

Что делать?

Тестируйте элементы, которые влияют на принятие решений. Тестируйте элементы, с которыми взаимодействуют посетители сайта:

— СТА-кнопки (кнопки призыва к действию типа «Купить», «Скачать», «Регистрация»)

— Формы (для регистрации, подписки на сайт, оформления покупки)

— Текстовые элементы (Заголовки, подзаголовки, описания товаров, преимуществ, выгод для потенциального клиента)

— Визуальные элементы (Изображения, видеоролики, аудио)

— Страницы с ценами (Сами цены, описания ценности для клиента, значки безопасности, гарантии возврата денег)

Тестирование этих элементов является наиболее эффективным.

Копирование чужих экспериментовЭто простой способ «входа» в A/B тестирование. Не нужно сильно мучиться и загоняться по поводу гипотез для экспериментов. Берёшь и копируешь какой-нибудь успешный эксперимент. Кейсов и списков идей для A/B тестирования много. Они так и манят взять и повторить. Но это неэффективно.

Почему неэффективно?

Потому что у каждого сайта своя целевая аудитория. Эта целевая аудитория взаимодействуют с сайтом в соответствии со своими потребностями. Аудитория приходит на сайт с разных каналов. В итоге слишком много факторов влияют на её поведение.

И тупое копирование чужих кейсов вряд ли поможет кардинально исправить сайт и увеличить конверсию. Уж слишком всё индивидуально. Поведение пользователей на сайте зависит даже от того, какой текст использовался в вашем рекламном объявлении. Если на этом этапе всё плохо, то следование чужим успешным кейсам никак не поможет.

Расскажу об одном очень интересном кейсе. В интернет-магазине проводился A/B тест. Получилось так, что конкурент, который полностью скопировал сайт этого интернет-магазина, увидел тестовую страницу. И, в своём стиле, реализовал этот вариант страницы у себя. Через несколько недель эксперимент завершился. Конверсия в тестовом варианте оказалась ниже. Но конкурент уже об этом не узнал. Во всяком случае, в течение какого-то периода времени. Вот такие чудаки бывают.

Что делать?

Думайте своей головой. Все инструменты для анализа сайта и поведения пользователей у вас под рукой. Ищите проблемы конкретно на своём сайте, изучайте свою аудиторию. И запускайте тесты на основе полученных данных.1

При этом я ни в коем случае не ратую за то, чтобы вы прекратили изучать чужие кейсы. Это хорошая пища для ума. Подробно разобранные кейсы открывают глаза на многие вещи и заставляют совершенно иначе взглянуть на собственный сайт. Просто не нужно слепо следовать чужому примеру. Изучайте, анализируйте и берите из чужих кейсов самое лучшее.

Кстати, в любом случае A/B тестирование чужих кейсов лучше, чем прямая реализация идей с чужого сайта у себя. Если бы ребята из примера выше затестили новый вариант, то не потеряли бы часть клиентов.

Неправильное параллельное A/B тестированиеПод неправильным параллельным A/B тестированием я имею в виду ситуацию, когда посетители, участвующие в эксперименте на одной странице, попадают и в другой эксперимент. Например, в первом эксперименте они видят оригинальный вариант, а во втором — тестовый. В итоге это может повлиять на достоверность результатов, если анализировать влияние эксперимента на всю воронку продаж.

Что делать?

Если вы точно уверены, что аудитория экспериментов не будет пересекаться, то расслабьтесь и продолжайте тестить. Если нет, то даже не начинайте параллельные эксперименты. Запускайте эксперименты друг за другом. Это займёт больше времени, но даст более достоверные результаты.

Надежные результаты важнее, чем скорость тестирования. Все неправильные выводы потом вылезут боком1, и придётся проводить повторные тесты, чтобы обнаружить проблему.

A/B тестирование на сайтах с маленьким трафикомК чему это приводит?

Эксперимент растягивается на месяцы (а проводить так долго тест не советуют!). Из-за длительного ожидания делаются преждевременные выводы (дождаться нужного количества конверсий очень сложно). Результаты эксперимента являются недостоверными. В итоге всё время и силы потрачены зря.

Так будет в большинстве случаев, если на сайте в день происходит 5-10 и даже 20 конверсий. В таких условиях, например, успешным можно будет считать тот эксперимент, в котором разница в конверсии будет очень значительной (Например, 150 конверсий против 75). Но подобное происходит редко.

А ведь небольших сайтов очень много. Также много и сайтов, где средний чек относительно большой и несколько сделок в день — это отличный результат.

Что делать таким сайтам?

Не тратить время на A/B тестирование, пока на сайте нет достаточного количества трафика и конверсий. Вместо этого, нужно заниматься анализом поведения пользователей на сайте. Нужно анализировать карты кликов и скроллинга и, исходя из этого, искать очевидные проблемы. Нужно общаться с целевой аудиторией и, исходя из потребностей/страхов/желаний, изменять тексты/элементы на сайте. Нужно смотреть записи действий посетителей (с помощью Вебвизора в Яндекс Метрике или Hotjar).

Такой вариант будет более эффективным.

Кстати, ещё один важный момент касательно трафика. Прежде, чем приступать к A/B тестированию, нужно грамотно настроит каналы качественного трафика, который будет день за днём приходить на сайт. Когда вы сможете обеспечить стабильный поток посетителей, тогда и будете думать об A/B тестировании.1

Aнализ результатов A/B теста без использования сегментированияК чему это приводит?

Без сегментирования вы никогда не сможете проанализировать, как отдельные группы пользователей взаимодействовали с сайтом в тестовом варианте. И это одна из ключевых ошибок анализа.

Сравните хотя бы два сегмента пользователей — новые и вернувшиеся. Подумайте, насколько сильно различается их поведение на сайте? Есть идеи?

У меня есть реальные цифры. Поведение новых и вернувшихся пользователей совершенно разное.1 В интернет-магазинах вернувшиеся пользователи в среднем проводят на 3 минуты больше, чем новые. Новые посетители в среднем просматривают 3.88 страниц за сессию, а вернувшиеся — 5.55 страниц.

Достаточно, чтобы задуматься об анализе A/B тестов с помощью сегментирования? Думаю, да.

Поведение пользователей смартфонов и ПК тоже отличается. И по таким сегментам тоже нужно прогонять результаты эксперимента. Вполне возможно, что на одних устройствах конверсия снизилась, а на других — сайтом стало гораздо удобнее пользоваться, и конверсия увеличилась.

Что делать?

После проведения эксперимента смотреть не только общие цифры, но и лезть глубже. Всервисах для A/B тестирования, которые интегрированы с Google Analytics, есть возможность провести глубокий анализ результатов и применить к ним любой сегмент.

Кстати, совсем недавно проводил A/B тест на главной странице одного сайта. Объект тестирования — короткий дополнительный текст, поясняющий то, что произойдёт после регистрации. Анализируя результаты без применения сегментирования, обнаружилось, что тестовый вариант с дополнительным текстом работал немного хуже оригинального — на пару процентов конверсия была ниже.

Применив сегмент «Новые пользователи» к результатам эксперимента ситуация оказалась совершенно иная — тестовый вариант имел конверсию на 10 % больше.

Вывод: для вернувшихся пользователей этот текст не имел никакого значения, т.к. они кликали на СТА-кнопку в любом случае. А для новых пользователей текст всё-таки оказался одним из триггеров, который подталкивал совершить целевое действие.

Анализ влияния A/B теста только на одну цель в воронке продажСтандартная воронка продаж состоит из нескольких этапов. В интернет-магазине она может быть такой: Главная страница сайта — Переход в каталог продукции — Переход в карточку товара — Добавление товара в корзину — Переход к оплате товара — Завершение оплаты.

Представьте ситуацию, что вы запускаете эксперимент в каталоге товаров. Например, добавляете в призыв к действию информацию о 20 % скидке. Через неделю вы анализируете результат эксперимента и видите, что посетителям это нравится — они чаще кликают на эту кнопку и переходят в карточку товара. На первый взгляд, всё отлично. Ведь кликабельность кнопки увеличилась и на следующий этап воронки продаж переходит больше людей.

Но, ведь клики на эту кнопку — не главная цель вашего интернет-магазина. Самое важное — это оплата товара. Если посетители заходят в карточку товара, но при этом не заказывают его, то какой от этого смысл? Никакого.

К чему приводит эта ошибка?

Из-за поверхностного анализа эксперимента относительно только одной цели, вы не видите влияние на всю ворону продаж. А вдруг добавление привлекательной скидки повлияло на количество импульсивных кликов на эту кнопку? Посетители кликали, но при этом ещё были не готовы к покупке. На следующих этапах конверсия могла наоборот снизиться.

Не анализируя влияние на другие цели, вы этого не узнаете. Вы просто установите на сайт «победивший» вариант, а через какое-то время при подсчёте финансовых показателей обнаружите, что доходы упали. Результат — время потеряно зря, доходы просели.

Что делать?

После того, как эксперимент завершился, не спешите реализовывать лучший вариант.Проанализируйте влияние эксперимента на всю воронку продаж, начиная с цели, которую вы пытались улучшить, и заканчивая конечной целью (например, оплатой).

Сделать это очень легко, если эксперимент сделан через Google Analytics, Changeagain илидругой сервис , интегрированный с Google Analytics. Там можно посмотреть влияние на все созданные цели.

Кстати, мы уже описывали целый кейс с такой ошибкой. Почитать более подробном о нём можно здесь.

Пренебрежение «тестированием» страниц после запуска экспериментаЭксперименты часто «ломаются». Запуск эксперимента происходит через специальный js-код, который вставляется на страницы сайта. Как показывает моя практика руководителя сервиса для A/B тестирования, проблемы были, есть и будут. Начиная с того, что могут возникнуть проблемы со страницей, СТА-кнопками или просто эксперимент не будет загружаться.

Все сайты разные: используются различные языки программирования, различные CMS-платформы и т.п. Более того, некоторые сайты пишут программисты с кривыми руками. И из-за этого может возникнуть конфликт между сайтом и сервисом.

К чему это приводит?

Вы запускаете тест. Думаете, что всё в порядке: пользователи видят оригинальную и тестовую страницу, статистика собирается, заказы идут. А на самом деле всё наоборот.

Эксперимент может вообще не отображаться всё это время. И если не проверить статистику через пару дней, то через неделю вы будете очень сильно удивлены отсутствием результатов.

Кнопки могут не работать. Я лично сам столкнулся с ситуацией, когда изменение одного элемента в тестовом варианте ломало структуру сайта и кнопка просто не нажималась (настолько криво был написан сайт).

Что делать?

Сразу после запуска эксперимента нужно зайти на сайт и проверить:

— все вариации теста (как это выглядит)

— основные функции сайта (работоспособность всех кнопок)

Это обязательный и очень важный этап, которые советует делать Сергей Гудков(специалист по увеличению конверсии). Он дошёл до этого сам после нескольких ошибок.

«Поверил программистам. Тест через неделю проиграл. Я был в варианте А. Жалко было, что тест проиграл. Пошёл анализировать ситуацию и оказалось, что там была ошибка. Кнопка отрабатывала через раз. Исправили. Тест пришлось перезапускать»

Как правильно проверить все вариации эксперимента?

Для этого нужно воспользоваться функцией «инкогнито» вашего браузера и открыть там страничку с экспериментом. Но здесь есть несколько важных нюансов.

Когда пытаетесь проверить отображение тестового варианта в режиме инкогнито, если открыли одну вкладку и попали на оригинальный вариант, то закройте эту вкладку. После этого открывайте новую 1 вкладку инкогнито. И так, пока не попадёте на тестовый вариант.

Если же вы сразу же откроете 5 вкладок инкогнито и вставите туда ссылку, где должен отображаться эксперимент, то именно та страница, которая отобразится на 1-ой вкладке, будет открываться и на всех остальных.

Отказ от A/B тестирования после первых неудачных попытокВот я тут всё пишу и пишу про A/B тестирование, пытаясь продвинуть этот крутой инструмент увеличения конверсии. И боюсь лишь одного — чтобы люди не подумали, что этот инструмент так запросто может помочь любому сайту. Это не так.

Большинство A/B тестов будут проваливаться. Такова реальность. Это неприятно, это не воодушевляет. Но на всё нужно смотреть объективно. По своей практике могу сказать, что неудачных экспериментов больше, чем удачных.

Чаще всего от A/B тестирования отказываются после первых неудач. Первый, второй, третий эксперимент, и ну его нахер. Проще не парить себе голову чем-то новым и сложным, а находится «в колее», в своей зоне комфорта и делать всё по стандартным правилам.

Если я создал у вас впечатление того, что A/B тестирование — это волшебная «пилюля», то простите. Легко не будет. Если не готовы усиленно пахать, даже не беритесь.

Что делать?

Чтобы не разочаровываться и отказываться от A/B тестирования, нужно больше времени тратить на подготовку к эксперименту. Анализ проблем на сайте и поиск идей для тестирования — это должно быть в приоритете.

Чем больше времени и усилий будете тратить на анализ сайта, тем лучше будут гипотезы для тестирования. Чем лучше поймёте свою целевую аудиторию, тем лучше сможете подготовить тестовый вариант. Идея для тестирования и результат тестирования находятся в прямой зависимости. Чем лучше проделан первый этап, тем выше вероятность положительного результата.

Даже если первые эксперименты провалились, не останавливайтесь на этом. Просто пересмотрите свой подход к генерации гипотез. Если вы начали с анализа карты кликов и скроллинга и все гипотезы придумали на основе этого, то попробуйте провести юзер-тестинг, изучить переписку клиентов со службой поддержки или вообще лично пообщайтесь с целевой аудиторией.

Когда компания Hubspot проводила опрос интернет-маркетологов, то 85 % из них сказали, что в 2015 году A/B тестирование будет одним из приоритетных направлений их деятельности. Все прекрасно знают, откуда идут тренды интернет-маркетинга. Поэтому было бы глупо отказываться сейчас от такого инструмента. Ведь через 2-3 года это будет инструмент «по умолчанию» в любой средней, крупной, а может даже и маленькой компании.

Отсутствие чёткого плана A/B тестированияК чему это приводит?

К хаотичному тестированию. A/B тестирование требует систематизации и последовательности. Без этого сложно поставить процесс тестирования на поток. После каждого эксперимента будет возникать вопрос: Что тестить дальше? Придётся отвлекаться, опять искать идеи для тестов, и так каждый раз. Это реально неудобно. Проверено на себе.

Что делать?

При подготовке к A/B тестированию нужен чёткий план. В этом плане должны быть описаны:

— проблема на сайте

— идея A/B теста для решения этой проблемы

— сложность реализации эксперимента

— примерный срок проведения эксперимента (зависит от количества трафика и конверсий на странице)

— приоритетность эксперимента (исходя из сложности реализации, времени и потенциального результата)

Для составления такого плана лучше засесть на несколько дней над сайтом и проанализировать его в Google Analytics, в Яндекс.Метрике (карты кликов, вебвизор), переписки службы поддержки и консультантов по продажам, провести юзер-тестинг.

В общем, это я всё к тому, что нужно за 1 раз потратить день или два на подробный анализ, свести всю информацию в таблицу и выстроить гипотезы в зависимости от их приоритетности. Дальше все будет гораздо проще по принципу Hypothesis (Идея для тестирования) — Action (Запуск теста) — Data (Сбор данных) — Insight (Анализа результатов, выводы). И так по кругу.

Лично в своей практике к эффективному A/B тестированию я перешёл только в тот момент, когда составил две ключевые таблицы. Первая — это чеклист, по которому прогонял каждый сайт для поиска слабых мест и проблем. Вторая — это таблица для описания основных проблем и расстановки приоритетов на основе тех факторов, которые описаны выше. Так лично у меня произошёл переход от хаотичного A/B тестирования к последовательному.

Надежда на то, что маленькие изменения сильно увеличат конверсиюК чему это приводит?

Весь процесс A/B тестирования сводится к незначительным изменениям. Что-то вроде изменения цвета кнопки, текста кнопки, заголовка, удаление поля в форме и т.п.

Запустить такой эксперимент через специальный сервис проще простого. Двух минут хватит для этого. Но тогда и не стоит ожидать серьёзного роста конверсии от такого эксперимента.

При этом я не хочу сказать, что такие эксперименты не нужно проводить. Я сам делаю это. И такие эксперименты срабатывают. Просто происходит увеличение конверсии не в 2 раза, а на 10-20 %, что тоже является отличным результатом.

Просто нужно реально оценивать ситуацию. Если начинать A/B тестирование с мыслью о том, что изменение цвета кнопки улучшит ваш бизнес, то совсем скоро вы перестанете этим заниматься. Вы просто разочаруетесь.

Что делать?

Проводить эксперименты не только с маленькими изменениями на странице, но и ставить более серьёзные гипотезы, изменяя процесс взаимодействия пользователей с сайтом.

Рассмотрим пример с формой подписки на сайте. Форма с двумя полями — имя и e-mail + СТА-кнопка «Подписаться». Эта форма может размещаться прямо на странице. И в A/B тесте можно удалить поле «имя» или поменять текст/цвет кнопки. Это совсем незначительные изменения. И не факт, что они будут эффективными.

А можно сделать эту форму в два шага: разместить на сайте только кнопку «Подписаться», после чего будет открываться форма для заполнения. Это изменение уже делает процесс взаимодействия пользователей с формой другим. И результат такого эксперимента может быть более значительным, как в положительную сторону, так и в отрицательную.

Кстати, это одна из идей тестирования. Многие утверждают, что второй вариант с кнопкой и открывающейся формой работает эффективнее.

A/B тестирование в два этапаЭто самый простой способ A/B тестирования, который уже давно пора прекратить использовать. Но, как показывает опыт, его активно практикуют и не собираются останавливаться.

Смысл такого способа заключается в следующем: на месяц, например, на сайт ставится первая версия страницы. В конце месяца измеряются основные показатели страницы. После этого устанавливается вторая версия страница и происходит то же самое. Через 2 месяца у нас есть показатели эффективности двух страниц. Они сравниваются, и выбирается более эффективный вариант. Всё так просто.

К чему это приводит?

К недостоверным результатам. Качество трафика может сильно отличаться в первом месяце по сравнению со вторым. Если качество трафика отличается, то сравнивать результаты просто невозможно. Их нельзя сопоставлять.

Представьте ситуацию. У вас интернет-магазин. Вы запускаете A/B тест в два этапа в ноябре. С 1 по 31 ноября показываете всем посетителям первый вариант страницы. 1 декабря подводите итоги, фиксируете основные показатели сайта и запускаете новый вариант страницы с 1 по 31 декабря. При этом в декабре начинается пик продаж, так как все готовятся к Новому Году и закупают подарки. Аудитория в декабре гораздо более склонна к покупкам. Соответственно, её поведение отличается от поведения в предыдущем месяце. Всё, такие результаты нельзя сравнивать. Они несопоставимы.

А теперь подумайте, сколько праздников проходит, сколько различных рекламных каналов вы подключаете, сколько акций делаете. Если в течение двух этапов у вас были разные маркетинговые активности, то и качество аудитории может быть совершенно разным. Если хотите работать с недостоверными результатами экспериментов, то продолжайте так делать.

Что делать?

Если же вы хотите делать A/B тесты правильно, то тестируйте все варианты в течение одного периода времени, на одинаковом трафике. Тогда надежность данных будет выше.

Причём необязательно платить за то, чтобы проводить правильное A/B тестирование. Вы можете делать это через Google Analytics, вкладка «Поведение» > «Эксперименты». Это сложнее, чем через платные сервисы (Источник: http://oosta.ru/services/ab-testing/), но полностью бесплатно.

Вы можете отказываться от технологий, которые упрощают и позволяют проводить A/B тестирование правильно. Но через пару месяцев вы поймёте несостоятельность такого подхода.

A/B тестирование сайтов из 90-хНе совсем стандартный пункт. Но очень захотелось добавить. Посвящен он владельцам бизнеса и интернет-маркетологам, чьи сайты давно не обновлялись и совсем не соответствуют трендам веб-дизайна, «недружелюбны» к посетителям.

К чему приводит тестирование таких сайтов?

К пустой трате времени. В таком случае вы будете пытаться улучшить то, что нужно просто «снести» и создать заново. И уже новый интерфейс систематически тестировать.

Не раз ко мне обращались с просьбой увеличить конверсию сайта. Когда я смотрел на некоторые сайты, хотелось просто закрыть глаза, а рука через 2 секунды тянулась к «крестику».

Юзабилити сайта бывает настолько убогим, что там нельзя ничего тестировать. Противопоказано!

Тесты будут гораздо более затратными и по времени, и по написанию кода, чем одно единственное обновление сайта.

Что делать?

У вас должен быть как минимум удобный для пользователей сайт, со стабильным целевым трафиком и совершаемыми конверсиями. Если сайт удобный, если трафик идёт, конверсии есть, и есть понимание, что их количество можно увеличить, то тогда можно задумываться об A/B тестировании. В противном случае, забудьте об этом. К сожалению, A/B тестирование ещё не достойно вас.

Вроде бы охватил все возможные ошибки. Если у вас есть, что добавить, то оставьте свой комментарий. Тогда я смогу внести ещё одну ошибку в статью. Полезно будет всем!

И да, ребята, если уж собираетесь проводить A/B тесты, то делайте это правильно!

Оригинал: http://boosta.ru/ab-testirovanie/mistakes/eti-17-oshibok-poxoronyat-vash-ab-test/

тестирование — что это, как и для чего проводить A/B тест сайта

Содержание статьи

- Что такое A/B тестирование

- Сервисы для А/В тестирования

- Как проводить A/B-тестирование в Google

- Как тестировать варианты страниц

- Основные этапы A/B тестирования

- Рекомендации по A/B-тестированию

- Выводы

Конкуренты не дремлют. Чтобы бизнесу выжить в онлайн-сфере, успешно завоевывать внимание аудитории и обходить аналогичные проекты, нужно развиваться. В противном случае сайт начнет деградировать.

Для развития используют разные методы: расширяют ассортимент, улучшают дизайн ресурса, прорабатывают юзабилити, пишут новые продажные статьи. Но как заблаговременно узнать, что эти нововведения действительно принесут результаты и не станут напрасной тратой времени и денег?

Что такое A/B тестирование

A/B тестирование — это инструмент помогает развивать сайт и проверять гипотезы. Разработчикам удается путем экспериментов оценить предпочтения аудитории, чтобы решиться на изменения или оставить все как есть. А/Б тестирование, или как его еще называют, сплит-тестирование, представляет собой своеобразный способ оптимизации воронки сайта.

Рассмотрим подробнее то, как работает инструмент, для чего проводят такие тесты и каким образом реализуются задачи.

Как работает A/B-тестирование?

Если вкратце, то сплит-тесты позволяют оценить эффективность разных вариантов страницы. Допустим, у вас есть два примера дизайна карточки товара, и они оба ну очень круты. Какой из них выбрать? Основываться на интуиции — не лучшее решение. Проверьте работоспособность обоих вариантов на практике посредством тестирования сайта. Покажите одной части посетителей карточку №1, а другой — №2. Победителем становится тот, у кого показатели отклика выше.

Это далеко не единственный метод применения AB-тестов. Инструмент помогает проверять всевозможные гипотезы, удобство обновленной структуры, различные варианты текстов и многое другое.

Зачем нужны А/B (сплит) тесты

Электронная коммерция сражается с оставленными корзинами, b2b страдают от «пустых» лидов, а СМИ не могут повысить вовлеченность читателей. Все эти сферы объединены схожими проблемами: падением конверсии, потерей клиента на стадии оплаты заказа и проч.

A/B testing поможет выйти из сложной ситуации, а именно:

- Решит проблемы посетителей. Пользователи заходят на ресурс с определенной целью: узнать о товаре подробнее, что-то приобрести или просто посмотреть. При этом посетители сайта сталкиваются с типичными сложностями. К примеру, кнопка «Заказать» находится в неудобном месте или ее трудно найти. Подобные моменты негативно сказываются на опыте пользователей и точно так же сказываются на конверсии.

- Повысит окупаемость инвестиций. Бессмысленно рассказывать маркетологу о том, каким дорогим оказывается качественный трафик. Он давно все это знает. Тестирование и аналитика сайта обеспечивают более эффективное использование текущего трафика и повышают конверсию без расходов на привлечение нового. Порой даже мелкие корректировки положительно влияют на метрики.

- Снизит количество отказов пользователей. Чтобы оценить результативность работы сайта, важно анализировать этот показатель. Люди закрывают страницу ресурса по разным причинам: несоответствие ожиданиям, неудобная форма заказа, сложности с поиском товара и т. д. С помощью тестирования можно создать несколько вариантов расположения элементов и проверить, какой из них работает лучше. Если увидели положительную динамику, можно вносить глобальные изменения.

- Минимизирует риски от корректировок. Эксперты советуют вносить изменения дозированно и последовательно, чтобы не потерять показатель конверсии. Например, понадобилось внедрить новую функцию на сайт. Проведите тестирование и посмотрите, какой из вариантов получился более выигрышным.

- Обеспечит статически значимые улучшения. A/B анализ базируется на конкретных сведениях, а не на гадании на кофейной гуще. Вы с легкостью можете определить выигрышный вариант изменений на основе статически значимых улучшений: время пребывания на странице, число оставленных корзин и т. д.

- Поможет усовершенствовать дизайн. Масштабы редизайна бывают разными: от замены пары цветов до полного преображения ресурса. Необходимо выбирать решение только по итогам сплит-тестов. Сначала внесли небольшое изменение, протестировали и убедились, что оставили лучшую версию.

A/B-тестирование — нужная мера, и это вне всяких сомнений. Оно поможет привести показатели сайта к желаемым и гарантировать, что потраченные на изменения деньги и время будут оправданы.

Сервисы для А/В тестирования

Маркетологи выполняют сплит-тесты при помощи специализированных инструментов. Самый востребованный — Google Optimize. Он помогает тестировать определенные элементы страниц, в том числе заголовки, шрифты, картинки и проч. Есть бесплатный вариант инструмента, что и делает его популярным на фоне конкурентов.

Другие сервисы для тестирования страниц:

- Optimizely — платный инструмент. В нем можно создавать эксперименты в визуальном интерфейсе, благодаря чему специалистам не требуется работать с HTML-кодом. Точная цена использования инструмента нигде не указывается, поэтому лучше уточнить ее в отделе продаж;

- Visual Website Optimizer — еще один платный сервис для тестирования элементов страниц. В работе специалисту понадобится понимание HTML. Месяц подписки на сервис будет стоить от $99 до $999;

- Unbounce — инструмент, при помощи которого удобно создавать и оптимизировать лендинги, проводить сплит-тесты. В месяц за подписку придется тратить от 79 до 399 у. е. и больше;

- Convert.com — находится в числе самых популярных среди отечественных маркетологов. Привлекает продвинутым таргетингом и возможностью отслеживать одновременно несколько метрик.

Тонкости проведения сплит-тестов во многом зависят от интерфейса и особенностей сервиса. Но в целом алгоритм действий будет одинаковым.

Как проводить A/B-тестирование в Google

Проводить тесты с помощью нескольких разных сервисов — это трудоемко, сложно и дорого. Лучше сосредоточиться на одном проверенном. К примеру, воспользоваться популярными сервисами от Google.

A/B тесты в Google Analytics

В этом сервисе есть удобная вкладка — «Эксперименты». Находится она в пункте «Поведение». Зайдите в «Эксперименты», введите урл страниц, участвующих в тестах, и получите код для вставки.

Обратите внимание: скрипт нужно добавлять только на исходную страницу!

Перейдите к запуску теста.

Примечательно, что Google А/Б тестирование не воспринимает как маскировку и накрутку. Наоборот, разработчики относятся к экспериментам нейтрально.

A/B тестирование с Google Optimize

Этот сервис используется в связке с Google Analytics: отсюда берутся сведения по показателям: доход, число транзакций и проч. Если описывать кратко работу в Google Optimize, схема будет выглядеть так:

- Зарегистрируйте аккаунт и определите тип эксперимента.

- Для настройки теста создайте варианты страниц и задайте распределение трафика на них.

- Свяжите Optimize с Analytics.

- Настройте цели в этом сервисе или выберите до этого заданные в Analytics.

- Введите настройки таргетинга — условия, при которых активируется эксперимент.

- Задайте код посредством Google Tag Manager.

- Введите в коде сайта скрипт, который скроет замену элементов.

Поскольку инструмент бесплатный, за раз вы можете запустить не больше 5 тестов и сделать до 10 подмен. Если нужно работать неограниченно, воспользуйтесь платным Google Optimize 360. В целом малому и среднему бизнесу хватает возможностей бесплатной версии.

Как тестировать варианты страниц

Узнаем об этом на примере все того же Google Optimize.

Отличия при настройке разных экспериментов будут находиться в разделе «Таргетинг и варианты».

Для многовариантного теста вы проверяете комбинации элементов (до 16 шт.). Потребуется:

- Указать названия разделов. Изначально выставлены имена «А» и «В». Если по эксперименту требуется больше, добавьте варианты кнопкой «Добавить раздел» и каждый назовите.

- Добавить в разделах варианты, которые будете сравнивать с исходником. Тоже дайте им названия, чтобы не путаться.

- Изменить элементы в визуальном редакторе. Выполните это для каждого варианта. К примеру, смените цвет кнопок.

Работает эксперимент следующим образом: посетитель заходит на исходную страницу. Ее адрес вы указывали при создании проекта. Сервис переадресует пользователя на один из тестовых вариантов (урлы вы задаете во время настройки).

Сразу же после запуска теста начинают составляться отчеты, с которыми вы можете ознакомиться в соответствующей вкладке.

Хорошо то, что Google Optimize сам определяет, когда пора завершить тестирование для получения достоверных сведений. Когда один из вариантов теста выигрывает, сервис автоматически начинает демонстрировать его пользователям.

Основные этапы A/B тестирования

Рассмотрим небольшую пошаговую инструкцию к тому, как проводить сплит-тесты.

Определение целей

Сначала сформулируем ключевые задачи компании или магазина и убедимся, что цели эксперимента с ними совпадают. Не проверяйте гипотезы, которые сразу не согласованы с глобальной целью. Если неверно выбрать ориентир, вы впустую потратите время и деньги.

Выбор метрики

Под понятием подразумеваются значимые показатели: количество продаж, чистая прибыль, число посетителей, доход и т. д. Для начала выберем одну метрику, но порой удобно рассматривать сразу несколько.

Если вы будете анализировать в рамках одного тестирования десяток метрик, эффективность работ значительно снизится.

Выдвижение гипотезы

Теперь переходим к важному этапу. Гипотезу выбирайте по схеме «если что-то сделать, то произойдет то». Например: если цвет кнопки «Заказать» изменить на зеленый, конверсия вырастет с 3–4 % до 7–8 %.

Чтобы верно оценить результаты, требуется выдвинуть 2 гипотезы:

- нулевая — к улучшениям не приведет и оставит показатель на прежнем уровне;

- альтернативная — корректировки повысят конверсию до 7–8 %.

Соответственно, если изменений не произошло, сработала нулевая гипотеза и вносить изменения бессмысленно. Если показатели выросли, альтернативный вариант победил. Это значит, что можно вносить более глобальные правки.

При негативном результате нужно просто откатить изменения и пробовать повышать метрику дальше.

Подготовка контрольных данных

Страница переделана, все готово к тестированию. Перед этим необходимо измерить исходные показатели конверсий и прочих метрик, которые будут учитываться. Первоначальный вариант называем А, новый — В.

Запуск теста

На этом этапе рандомно разделяем трафик 50/50. Половина пользователей увидит страницу А, остальная — В. Причем важно, чтобы состав трафика был равным. В противном случае тест будет необъективным.

Анализ результатов

Когда набралось достаточно сведений для статистики, пора оценить эффект А/Б тестирования. Выборка должна представлять статическую значимость. То есть вероятность случайности не должна превышать 5%.

По итогам анализа принимаем решение: распространить внесенные изменения на всю аудиторию или откатить до первоначальной версии.

Рекомендации по A/B-тестированию

Вы уже узнали, что сплит-тесты помогают повысить отдачу страниц. Чтобы они принесли результаты в действительности, специалисту нужно генерировать идеи для позитивного влияния на метрики. Нельзя придумывать правки наобум. Вы должны видеть пути улучшения страниц и понимать, почему именно они перспективные.

Но любой маркетолог порой попадает в ситуацию, когда протестированные идеи не помогли достичь целей. Если вы столкнетесь с подобным, попробуйте внести такие правки:

- используйте конверсионную форму, которая при прокрутке остается видимой для пользователя;

- уберите лишние поля. Возможно, посетитель не хочет указывать определенные данные и из-за этого отказывается совершить действие;

- увеличьте срок бесплатного тестирования вашего продукта;

- «поиграйте» с цветом конверсионных кнопок. Иногда положительную динамику дает агрессивный красный, а порой выигрышным становится спокойный зеленый.

Не опускайте руки после первой неудачи. Тестирование на то и называется тестированием, чтобы проверять, пробовать и экспериментировать.

Выводы

Вне зависимости от того, стал ваш эксперимент удачным или нет, относитесь к тестированию как к возможности для обучения. Пользуйтесь приобретенными навыками в создании и проверке последующей гипотезы. В любом случае рано или поздно получится найти те самые точки роста, которые помогут повысить показатели метрик и найти лучшее решение для развития бизнеса.

FAQ

Что такое A/B тестирование?

A/B тестирование представляет собой инструмент для развития сайта и проверки гипотез. Это особый метод оптимизации воронки ресурса. При его помощи разработчики оценивают предпочтения аудитории, определяя, требуется внедрять какие-то изменения или нет.

Когда проводить A/B тестирование сайтов?

А/В тестирование проводят, когда хотят оптимизировать ресурс, повысить продажи или выполнить анализ работы ресурса. Основная цель – сделать его более удобным для посетителей, подтолкнуть их оформлению заказов.

Что можно проверять с помощью А/В тестов?

Данный инструмент используется для сравнения базовой (контрольной) версии и оптимизированной, чтобы отследить реакции пользователей. Использовать А/В тестирование можно для оценки удобства обновленной структуры, нескольких вариантов текстов и прочих составляющих сайта.

Как провести A/B тестирование?

Для проведения A/B тестирования можно воспользоваться сервисами Google: Analytics, Optimize. Использовать их нужно в связке. Analytics отслеживает сведения по показателям (количество транзакций, доход и пр.), которые необходимы для использования Optimize.

У ВАС ОСТАЛИСЬ ВОПРОСЫ?

Оставьте ваши контактные данные. Наш менеджер свяжется и проконсультирует вас.

ПОЛУЧИТЬ КОНСУЛЬТАЦИЮ

Наш менеджер свяжется с Вами в ближайшее время

Отправить заявку

А/Б-тестирование в Яндекс.Директе — как провести и где брать идеи

Огромный потенциал развития любого проекта кроется в постоянном поиске новых точек роста и формировании гипотез для улучшения показателей с их последующей проверкой. А/Б-тесты должны быть неотъемлемой и непрерывной частью управления рекламой.

Переходить к проведению тестов можно, когда вся система маркетинга выстроена наиболее прозрачно: настроены цели, определены ключевые метрики для оценки результатов, запущены все основные типы ключевых слов и рекламных кампаний, есть продажи и выручка. Тогда смело выделяйте время, ресурсы и бюджеты на А/Б-тестирование для улучшения результатов продвижения.

С чего начать?

Сформируйте список гипотез — это предположения о том, где рекламная кампания может работать лучше. Концентрироваться стоит не только на главной цели — получении продаж, можно работать над повышением конверсионности посадочной страницы и объявлений, уменьшением показателя отказов, увеличением кликабельности и прочим.

После формирования списка оцените, какой пункт может дать наибольший эффект, если гипотеза сработает. Так получится сформировать очередность тестов, выделяя в приоритет самые потенциально результативные решения.

Где брать идеи для тестов

-

Стандартные элементы. Под ними понимаются тексты объявлений, картинки, позиции в выдаче, стратегии управления ставками. Это прекрасный старт для внедрения процесса А/Б-тестирования. Внимательно наблюдайте за результатами, записывайте всё, что заметите, — это может стать отличной базой для следующих тестов.

-

Рекомендованные настройки и стандарты. Подвергайте сомнениям все настройки, особенно те, что диктуются рынком и системами как правильные и проверенные. К примеру, в сети Яндекса принято не использовать минус-слова: считается, что это ограничивает охват. А что если попробовать применить общий пакет минус-слов? Возможно, станет меньше трафика, но он будет более качественным.

-

Аналитика. Статистика может стать основным источником вашего вдохновения. На основе отчетов по рекламным кампаниям можно сформировать целый ряд гипотез о том, как улучшить каждый этап пути пользователя к покупке: от показа объявления до заказа на сайте.

-